Introdução

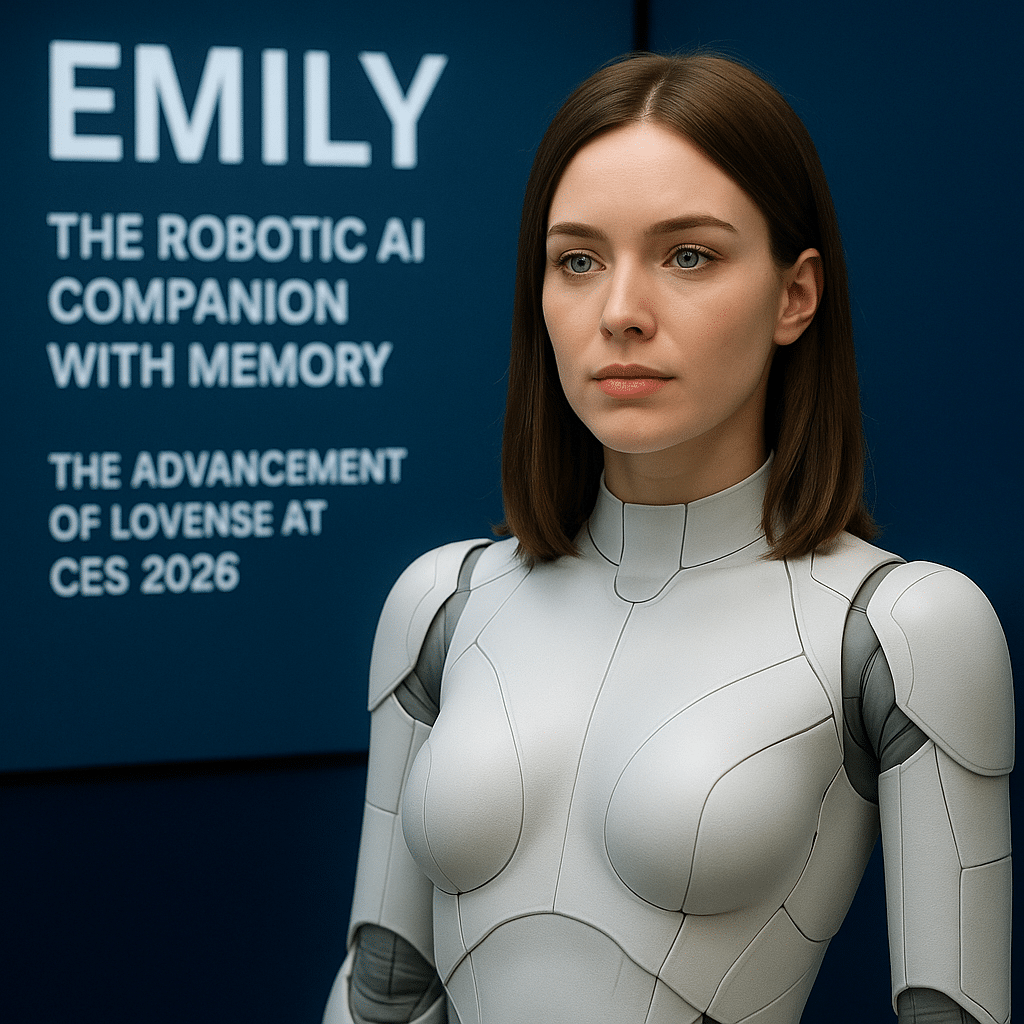

A feira CES 2026 trouxe uma novidade que chamou atenção não apenas pelo caráter tecnológico, mas também pelas questões éticas, legais e comerciais que suscita: Emily, uma companheira robótica em tamanho real desenvolvida pela Lovense, equipado com inteligência artificial conversacional e capacidade de memória para personalizar interações (ADDARICH MARTÍNEZ, 2026). Conforme reportado pela CNET, a proposta da empresa combina hardware físico com algoritmos de conversação e retenção de preferências, direcionada a um mercado de tecnologia íntima em rápida transformação (ADDARICH MARTÍNEZ, 2026).

Este texto oferece uma análise técnica, jurídica e sociocultural da apresentação da Lovense no CES 2026. O objetivo é fornecer ao leitor profissional e especializado uma avaliação embasada sobre arquitetura provável do sistema, riscos e mitigação relacionados à privacidade e segurança, implicações éticas e perspectivas de mercado. A matéria segue normas de citação da ABNT ao referenciar a reportagem original (ADDARICH MARTÍNEZ, 2026).

Contexto do lançamento e posicionamento da Lovense

A Lovense é conhecida por seus dispositivos sexuais conectados por aplicativo que permitem interação remota e integração com conteúdos digitais. Ao apresentar Emily no CES 2026, a empresa sinaliza uma expansão da sua atuação para o segmento de companheiros robóticos que unem presença física a capacidades de IA. Segundo a reportagem, Emily foi projetada para oferecer uma experiência mais personalizada por meio de memória de interações e conversação natural (ADDARICH MARTÍNEZ, 2026).

Esse movimento insere a Lovense numa frente competitiva que combina robótica, processamento de linguagem natural (PLN), aprendizado de máquina e sensórica corporal. Para o mercado, trata-se de uma tentativa de transformar dispositivos que eram predominantemente acessórios em plataformas integradas, potencialmente aumentando a receita por meio de serviços associados (assinaturas, atualizações de software e personalizações).

Arquitetura tecnológica: IA conversacional e memória

A descrição divulgada pela CNET indica que Emily incorpora um sistema de IA conversacional aliado a uma camada de memória que armazena preferências e dados de interação para adaptar respostas futuras (ADDARICH MARTÍNEZ, 2026). Em termos gerais, esse tipo de arquitetura costuma reunir os seguintes componentes:

– Módulo de percepção e sensórica: microfones, câmeras opcionais e sensores de toque que detectam estímulos físicos e contextuais.

– Pipeline de processamento de linguagem natural: modelos de PLN para reconhecimento de fala, entendimento semântico e geração de respostas.

– Banco de memória ou perfil do usuário: estrutura de dados que registra preferências, histórico de conversas, respostas emocionais e padrões de uso.

– Controlador de comportamento: regras e modelos que transformam intenções de alto nível em ações motoras e respostas verbais.

– Camada de conectividade e backend em nuvem: armazenamento, análises e atualização de modelos por meio de servidores remotos.

A combinção entre PLN e memória permite uma interação mais próxima daquilo que se espera de um assistente personalizado: a IA lembra preferências e ajusta o discurso, os tópicos abordados e, potencialmente, as reações físicas simuladas. Essa personalização, contudo, traz consigo um conjunto de riscos e responsabilidades que demandam avaliação técnica e regulatória rigorosa.

Privacidade e proteção de dados: desafios e obrigações (LGPD e padrões internacionais)

A retenção de memórias e o processamento de diálogos íntimos colocam dispositivos como Emily no centro de debates sobre privacidade. No Brasil, a Lei Geral de Proteção de Dados (LGPD) regula o tratamento de dados pessoais, exigindo bases legais para o processamento, direitos dos titulares e medidas de segurança adequadas. Internacionalmente, regimes como o GDPR na União Europeia exigem similares salvaguardas e direitos de exclusão.

Do ponto de vista prático, as questões principais são:

– Quais dados são coletados e por quanto tempo são armazenados? Interações, gravações de áudio ou transcrições podem ser sensíveis.

– Há criptografia de ponta a ponta para dados em trânsito e em repouso?

– Onde os dados são armazenados (países, provedores de nuvem) e quais leis locais se aplicam?

– Como é tratado o acesso de terceiros, como prestadores de serviço e pesquisadores?

– Quais mecanismos de consentimento e revogação são oferecidos ao usuário?

– Há anonimização ou pseudonimização eficazes, considerando que padrões de voz e comportamento podem ser identificadores?

A reportagem ressalta que a Lovense posicionou Emily como uma experiência personalizada, mas não detalha publicamente todos os aspectos técnicos de segurança e políticas de privacidade (ADDARICH MARTÍNEZ, 2026). Para conformidade com a LGPD e melhores práticas, fabricantes devem publicar políticas claras, implementar by design medidas de proteção, oferecer controle granular ao usuário e permitir portabilidade e exclusão de dados.

Riscos de segurança

Dispositivos conectados com microfones, câmeras e atuadores físicos são suscetíveis a vetores de ataque diversos. Vulnerabilidades podem incluir:

– Acesso remoto não autorizado, permitindo controle dos atuadores (risco físico).

– Interceptação de comunicações sem criptografia forte.

– Exfiltração de dados sensíveis de diálogos e perfis.

– Ataques por engenharia social que explorem backups de conversas ou perfis.

– Manipulação de modelos de IA por injeção de dados maliciosos resultando em comportamentos indevidos.

Experiências passadas com dispositivos IoT demonstram que fabricantes de tecnologia íntima precisam priorizar auditorias independentes de segurança, programas de recompensa por vulnerabilidades (bug bounty) e atualizações de firmware seguras. A transparência técnica, incluindo publicações de whitepapers de segurança, contribui para a confiança do mercado.

Ética e implicações sociais

A introdução de um robô sexual com memória suscita uma série de questões éticas profundas. Entre os pontos a serem avaliados:

– Consentimento e autonomia: como são modeladas respostas que simulam consentimento? De que modo o dispositivo evita perpetuar comportamentos abusivos ou normalizar violência?

– Objetificação e realismo: companheiros cada vez mais realistas podem reforçar estereótipos e afetar relações humanas. Há debates sobre se a tecnologia deve replicar ou reconfigurar padrões sociais.

– Saúde mental e dependência: a disponibilidade de interações personalizadas pode beneficiar algumas pessoas (ex.: redução de solidão), mas também há riscos de isolamento social e dependência.

– Responsabilidade e atribuição de culpa: se um sistema com memória desenvolve respostas inesperadas, quem é responsável — fabricante, desenvolvedor do modelo, usuário?

– Impacto em trabalhadores do sexo: a difusão de companheiras robóticas pode ter efeitos econômicos no setor de serviços íntimos.

A literatura e especialistas destacam a necessidade de um debate público informado e de diretrizes éticas para o design dessas tecnologias. Fabricantes devem envolver comitês multidisciplinares (cientistas sociais, juristas, especialistas em ética) durante o desenvolvimento.

Regulação e conformidade: panorama e lacunas

Reguladores ainda estão adaptando frameworks para tecnologias emergentes que combinam IA e robótica íntima. A legislação tende a ficar atrás do ritmo de inovação, gerando lacunas que precisam ser supridas por:

– Normas técnicas e certificações específicas para dispositivos com atuadores físicos e IA conversacional.

– Diretrizes para privacidade de dados sensíveis, incluindo diálogos íntimos, com exigência de consentimento explícito e medidas de proteção elevadas.

– Regras claras sobre exportação e importação desses dispositivos, considerando diferenças culturais e legais.

– Incentivo a auditorias independentes e publicações de relatórios de impacto em privacidade (Data Protection Impact Assessments – DPIA).

A conformidade com a LGPD no Brasil exige que fabricantes estabeleçam bases legais claras para o tratamento (consentimento explícito é provável caminho), além de mecanismos para garantir os direitos dos titulares. Em outros mercados, requisitos complementares podem ser aplicáveis.

Mercado e modelos de negócio

A transição de produtos físicos para plataformas digitais cria oportunidades comerciais diversas:

– Vendas diretas de hardware com margens elevadas.

– Modelos de assinatura para atualizações de IA, vozes personalizadas e memórias expandidas.

– Monetização através de conteúdos, integrações e partnerships com provedores de entretenimento adulto.

– Serviços adicionais como manutenção, atualizações de segurança e garantias estendidas.

Entretanto, a sustentabilidade desses modelos dependerá da confiança do consumidor em relação à privacidade e segurança. Escândalos de vazamento de dados ou falhas de segurança podem ter impacto reputacional severo.

Reações do público e stakeholders

O anúncio de Emily provocou reações variadas: curiosidade tecnológica, preocupação ética e debates sobre regulamentação. Consumidores com interesse em tecnologia íntima podem enxergar valor na personalização; por outro lado, pesquisadores, ativistas e parte do público manifestaram apreensão quanto a privacidade, consentimento e influência cultural.

Para mitigar controvérsias, a Lovense e outras empresas do setor precisam adotar práticas transparentes, envolver stakeholders relevantes e submeter produtos a avaliações externas.

Considerações técnicas adicionais

Do ponto de vista técnico, alguns detalhes merecem atenção:

– Treinamento de modelos: para garantir segurança e evitar vieses, os dados usados no treinamento de modelos conversacionais devem ser curados, e mecanismos para detectar respostas impróprias precisam ser implementados.

– Atualizações e ciclo de vida: políticas de manutenção e patches de segurança são cruciais para reduzir risco de exploração de vulnerabilidades.

– Configurações locais versus nuvem: oferecer processamento local (on-device) pode reduzir exposição de dados, ao custo de maior demanda de hardware. Estratégias híbridas podem equilibrar desempenho e privacidade.

– Interoperabilidade: APIs e padrões abertos podem facilitar integrações, mas requerem controles de acesso rigorosos.

Recomendações para profissionais e decisores

Profissionais de tecnologia, reguladores e gestores interessados no tema devem considerar as seguintes recomendações:

– Realizar avaliações de impacto em privacidade (DPIA) antes do lançamento comercial.

– Implementar criptografia robusta e práticas de segurança por design.

– Fornecer termos de uso claros e mecanismos de consentimento granular, além de facilidades para exclusão de dados.

– Estabelecer auditorias independentes regulares, incluindo testes de penetração e revisão de modelos de IA.

– Incluir especialistas em ética e representantes de potenciais usuários nos processos de desenvolvimento.

– Monitorar e engajar-se nos esforços regulatórios para ajudar a formar padrões que equilibrem inovação e proteção.

Conclusão

A apresentação de Emily pela Lovense no CES 2026 marca um ponto de inflexão na convergência entre robótica física e inteligência artificial aplicada à interação íntima (ADDARICH MARTÍNEZ, 2026). Embora a tecnologia prometa experiências mais personalizadas e novas oportunidades de mercado, ela também amplifica necessidades de governança rigorosa: proteção de dados sensíveis, segurança técnica, avaliação ética e enquadramento regulatório adequado. Para que inovações desse porte tragam benefícios reais à sociedade, a transparência, responsabilidade e participação de múltiplos atores serão fundamentais.

Referências

ADDARICH MARTÍNEZ, Nasha. Your AI Girlfriend Has a Body and Memory Now. Meet Emily, CES’s Most Intimate Robot. CNET, 07 jan. 2026. Disponível em: https://www.cnet.com/tech/services-and-software/ces-2026-emily-sex-robot-with-memory/. Acesso em: 07 jan. 2026.

Fonte: CNET. Reportagem de Nasha Addarich Martínez. Your AI Girlfriend Has a Body and Memory Now. Meet Emily, CES’s Most Intimate Robot. 2026-01-07T22:01:00Z. Disponível em: https://www.cnet.com/tech/services-and-software/ces-2026-emily-sex-robot-with-memory/. Acesso em: 2026-01-07T22:01:00Z.