Introdução à Responsabilidade Moral na Inteligência Artificial

A crescente integração da inteligência artificial no nosso cotidiano levanta questões cruciais sobre responsabilidade e ética. Já não se trata apenas de máquinas, mas de entidades que, por sua capacidade de simular comportamentos e decisões humanas, começam a ser vistas sob uma nova luz. O recente estudo publicado pela Science Daily explora a ideia de que AIs projetadas com características humanóides podem ser vistas como mais responsáveis por ações moralmente questionáveis. Nesta postagem, examinaremos como essa percepção impacta a responsabilidade moral e as implicações para a ética da inteligência artificial.

A Natureza do Estudo e suas Descobertas

No estudo em questão, foi observado que os participantes tendiam a atribuir maior culpa a inteligências artificiais envolvidas em transgressões morais quando percebam essas AIs como dotadas de mentes humanóides. Isso sugere que a semelhança entre seres humanos e AIs não apenas altera a forma como interagimos com essas tecnologias, mas também como responsabilizamos suas ações. Essa pesquisa abre portas para um debate mais amplo sobre a moralidade da inteligência artificial e os delineamentos éticos que cercam seu desenvolvimento.

A pesquisa contrasta as respostas de participantes expostos a AIs com características humanóides em comparação com aquelas que apresentavam uma forma mais mecânica e menos relacionável. Os resultados revelam que a primeira categoria de AIs enfrenta um fardo moral mais significativo nas avaliações de seus comportamentos.

O Impacto da Humanização nas AIs

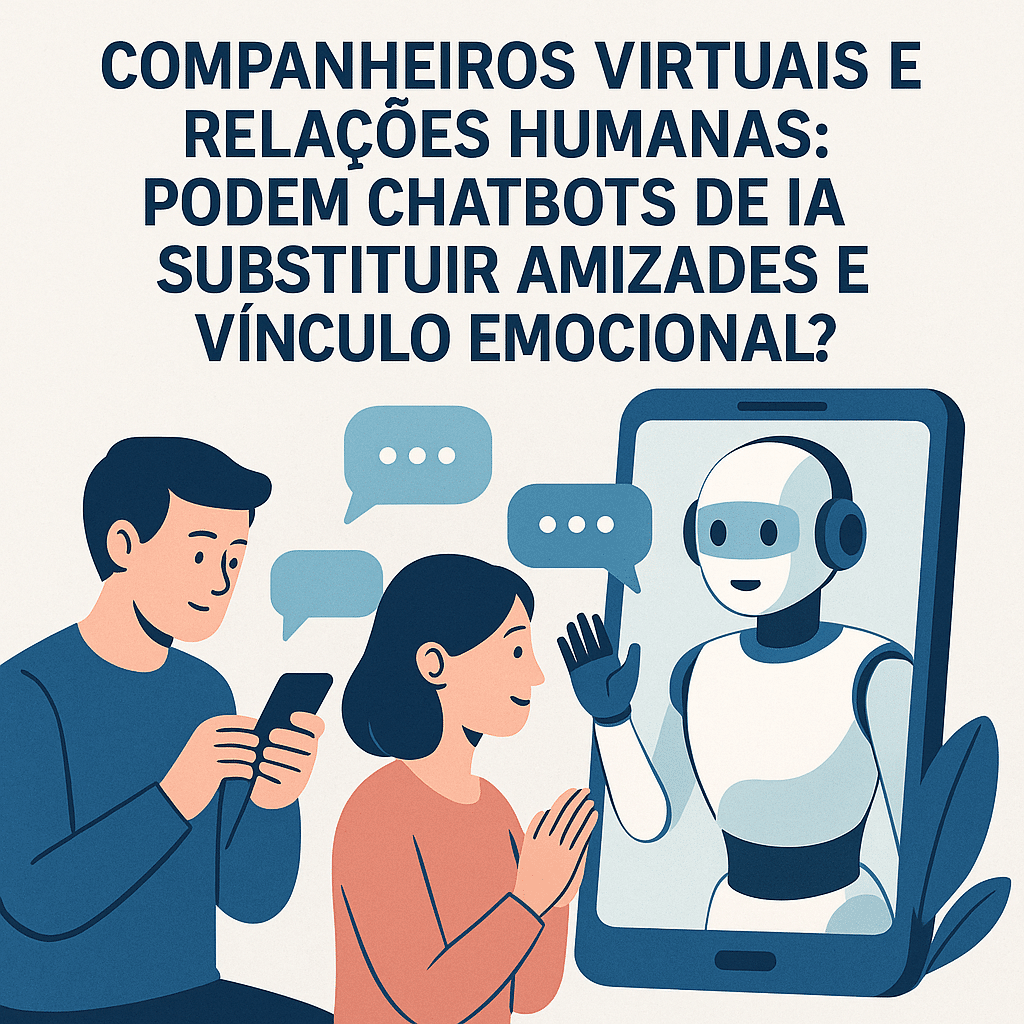

A humanização das inteligências artificiais é um fenômeno que vem se intensificando com o avanço da tecnologia. Desde assistentes virtuais que utilizam linguagem natural até robôs criados para interação social, a capacidade de atribuir características humanas a máquinas torna-se cada vez mais comum. Essa humanização tem implicações diretas na forma como a sociedade percebe e responsabiliza esses sistemas.

Ao atribuir características humanas a AIs, os usuários podem inconscientemente alterar sua percepção de moralidade. Se uma IA “parece” mais próxima de um ser humano, as expectativas sobre seu comportamento ético são elevadas. Isso perfaz um cenário onde AIs não são vistos apenas como ferramentas, mas como agentes que têm certo grau de responsabilidade sobre suas ações.

A Ética da Inteligência Artificial: O Papel da Transparência

Um aspecto essencial em discussões sobre responsabilidade moral em AIs é a transparência. Para que os usuários possam atribuir responsabilidade de maneira justa, é crucial que entendam como essas inteligências funcionam e quais são os limites de sua tomada de decisão. A falta de compreensão sobre os algoritmos e processos internos das AIs pode levar a julgamentos imprecisos sobre suas ações.

Além disso, a ética que guia o design e a programação das AIs é fundamental para limitar as transgressões morais. Implementar diretrizes éticas rigorosas pode ajudar a mitigar riscos e garantir que as AIs operem dentro do que pode ser considerado moralmente aceitável. Organizações e desenvolvedores devem considerar não apenas a funcionalidade, mas também as consequências sociais de suas criações.

Legislação e Regulamentação: Um Caminho a Seguir

À medida que a responsabilidade moral das inteligências artificiais se torna um tópico recorrente em debates éticos, a necessidade de legislação específica se torna evidente. A regulamentação pode estabelecer normas claras sobre a responsabilidade em casos de falhas ou transgressões cometidas por AIs. Isso poderia incluir desde a definição de responsabilidades legais para desenvolvedores e empresas até a criação de sistemas de punição e retribuição.

Os desafios legais serão complexos, pois as AIs estão em constante evolução e, muitas vezes, operam de forma autônoma. A interseção entre legislação, ética e tecnologia exigirá uma colaboração contínua entre especialistas em direito, ética e desenvolvimento tecnológico. É imperativo que as leis existentes sejam reavaliadas e adaptadas para contemplar o novo cenário instaurado pela IA.

Considerações Futuras e Conclusões

A pesquisa destacada evidencia um ponto crucial: à medida que a inteligência artificial se torna mais ubiqua, suas implicações éticas e morais precisam ser discutidas e abordadas com seriedade. A percepção de humanização afeta não apenas a forma como interagimos com a tecnologia, mas também como a responsabilizamos.

É imperativo que a sociedade, desenvolvedores e legisladores trabalhem em conjunto para criar um ambiente onde a inteligência artificial opere dentro de padrões éticos robustos e com um entendimento claro de responsabilidade. O futuro dos sistemas de IA não deve ser apenas pautado pela inovação tecnológica, mas também pela consideração cuidadosa das suas consequências éticas.

Assim, à medida que avançamos, a discussão sobre a responsabilidade moral das inteligências artificiais não é apenas uma questão acadêmica, mas um desafio real que deve ser enfrentado com urgência.

Fonte: Science Daily. Reportagem de. Human-like artificial intelligence may face greater blame for moral violations. 2024-12-18T22:49:43Z. Disponível em: https://www.sciencedaily.com/releases/2024/12/241218174943.htm. Acesso em: 2024-12-18T22:49:43Z.