Resumo do caso e fatos reportados

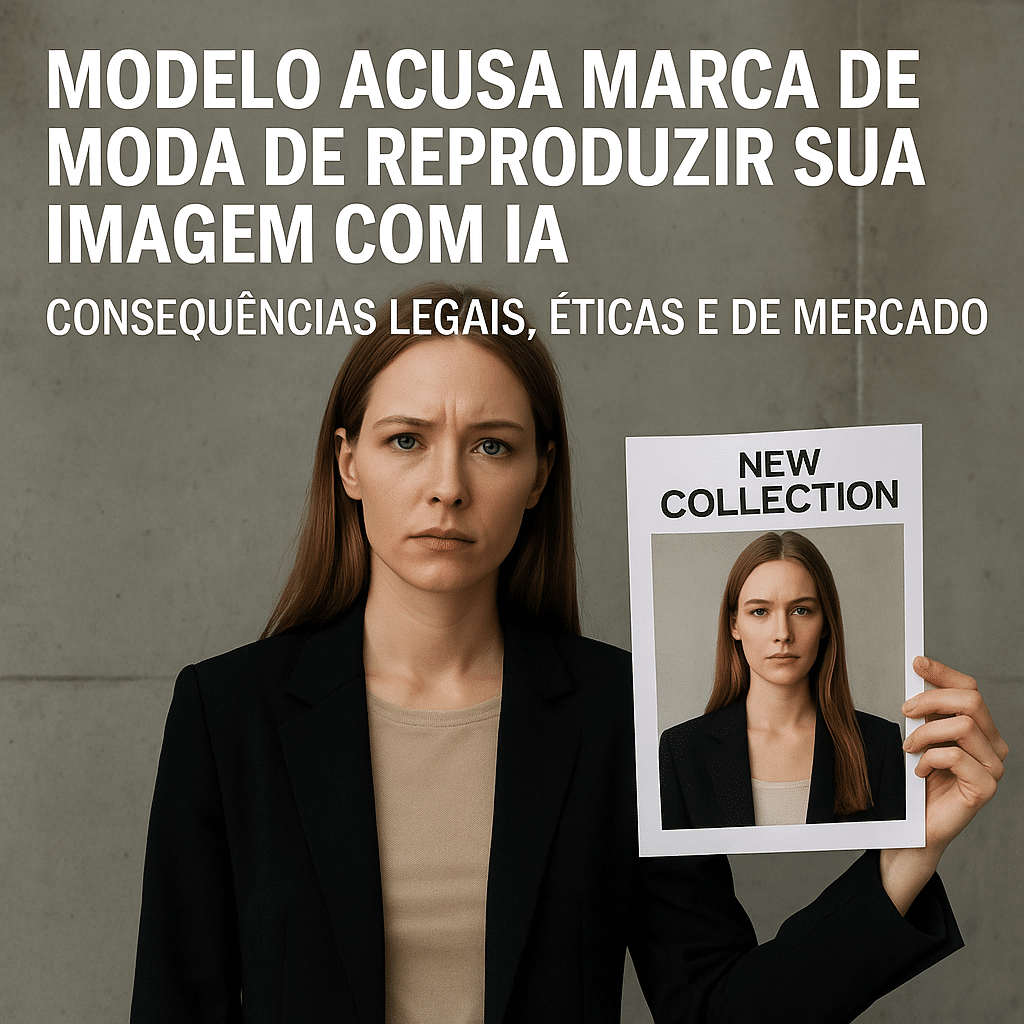

No final de fevereiro de 2026, a criadora de conteúdo Melanie Kieback relatou publicamente que uma empresa de moda teria veiculado um anúncio contendo imagens geradas por inteligência artificial que reproduziam sua aparência de forma muito próxima, sem sua autorização (LEI RV, 2026). Segundo a reportagem, publicada no portal BoredPanda, a influenciadora compartilhou nas redes sociais sua indignação e uma resposta direta: “Sue the living daylights out of them and hopefully get PAID.” (LEI RV, 2026). A acusação levantou uma série de questões sobre a utilização de ferramentas de geração de imagens por IA em campanhas comerciais, a proteção da imagem de trabalhadores criativos e os limites da criatividade publicitária quando conflita com direitos de personalidade.

A reportagem detalha que a influenciadora identificou semelhanças marcantes entre fotografias suas e as imagens exibidas no anúncio, o que motivou as alegações de reprodução indevida de sua identidade por meio de modelos sintéticos produzidos com tecnologia de inteligência artificial (LEI RV, 2026). Ainda que algumas empresas defendam o uso de ativos gerados por IA como solução para evitar custos de produção ou para ampliar diversidade visual, o episódio evidencia riscos reputacionais e jurídicos relevantes quando a geração de conteúdo aproxima-se de retratos reconhecíveis de terceiros.

Contexto tecnológico: como a IA gera imagens semelhantes a pessoas reais

Modelos de geração de imagens por inteligência artificial, como redes generativas adversariais (GANs) e transformadores visuais, produzem figuras realistas a partir de grandes bases de dados de imagens e de instruções textuais. Quando treinadas em acervos que contêm fotografias de pessoas reais, essas tecnologias podem recombinar traços faciais, estilos de fotografia e poses, produzindo resultados que, em determinados graus, se assemelham fortemente a indivíduos específicos.

Do ponto de vista técnico, a probabilidade de ocorrência de uma imagem que pareça com uma pessoa real depende de vários fatores: composição do conjunto de treinamento, prompts usados, ajustes de estilo e edição posterior realizada por designers. No entanto, a fronteira entre “inspiração” e “reprodução identificável” é tênue. Em contextos comerciais, essa distinção é crítica: imagens que permitam a identificação de uma pessoa sem seu consentimento podem configurar violação de direitos de imagem e exposição indevida (LEI RV, 2026).

Direito de imagem no Brasil: enquadramento legal

No ordenamento jurídico brasileiro, o direito de imagem é tratado como direito da personalidade, protegido contra uso não autorizado. O Código Civil (Lei nº 10.406, de 10 de janeiro de 2002) dispõe sobre a proteção da imagem e a necessidade de autorização para divulgação, salvo exceções previstas em lei. Além disso, atos ilícitos que resultem em dano moral ou patrimonial a um indivíduo podem ensejar reparação por via judicial.

A Lei Geral de Proteção de Dados (Lei nº 13.709/2018) também é relevante quando a utilização de imagens envolve tratamento de dados pessoais, especialmente quando esses dados permitem identificar uma pessoa. A utilização comercial de uma imagem que permite a identificação sem o consentimento do titular pode configurar tratamento inadequado de dados, ampliando as possibilidades de responsabilização da empresa (BRASIL, 2002; BRASIL, 2018).

No caso noticiado, a alegação de que uma imagem gerada por IA reproduziu a aparência de Melanie Kieback sem autorização pode configurar, dependendo da prova, violação do direito de imagem e potencial dano moral e patrimonial. Em termos práticos, será necessário demonstrar: (i) que a imagem é reconhecível como a pessoa; (ii) que não houve autorização para uso; e (iii) que a utilização foi com finalidade comercial ou causou algum prejuízo (LEI RV, 2026).

Precedentes e jurisprudência: como tribunais têm tratado casos semelhantes

Embora a aplicação das leis a imagens geradas por IA seja um tema emergente, tribunais em diversas jurisdições já vêm enfrentando litígios relacionados a deepfakes, uso indevido da imagem e criação de obras derivadas por meios tecnológicos. Em muitos desses casos, decisões têm considerado a intenção, o potencial de identificação e o dano causado pela divulgação pública.

No Brasil, precedentes sobre uso indevido de imagem (por exemplo, casos de publicidade com fotos não autorizadas) costumam reconhecer o direito à indenização por dano moral. Para casos envolvendo tecnologia, os juízes tendem a avaliar prova pericial técnica que comprove a origem e o grau de semelhança da imagem sintética com a pessoa real. Em suma, o caminho judicial é factível, mas exige produção probatória robusta, inclusive peritos em IA e análise forense de imagens (LEI RV, 2026).

Aspectos éticos e de responsabilidade corporativa

Além dos aspectos legais, a utilização de IA para criar imagens que se assemelhem a pessoas reais suscita questões éticas sobre consentimento, transparência e respeito à dignidade individual. Práticas responsáveis demandam políticas claras por parte das empresas de comunicação e marcas de moda, que devem:

1. Obter consentimento explícito quando uma imagem, mesmo gerada artificialmente, reproduza características identificáveis de uma pessoa;

2. Divulgar de forma transparente quando imagens foram produzidas por IA, evitando induzir o público ao engano;

3. Implementar auditorias internas sobre conjuntos de treinamento e políticas de uso de ativos gerados por IA para reduzir risco de reprodução não autorizada.

A adoção desses princípios não é apenas uma questão de conformidade jurídica, mas também de gestão de reputação. Casos públicos de suposto plágio ou de uso indevido de imagem podem acarretar boicotes, perda de confiança de públicos-chave e impacto negativo nas métricas de engajamento e vendas.

Impactos para influenciadores e criadores de conteúdo

Para profissionais cuja marca pessoal é um ativo central — como modelos e influenciadores — o risco de ver sua imagem replicada por meios artificiais representa uma ameaça direta à sua fonte de renda e à sua integridade profissional. Medidas recomendadas para proteção incluem:

1. Formalizar contratos claros com cláusulas de exclusividade e uso de imagem que prevejam abrangência temporal, territorial e finalidade de utilização;

2. Registrar fotografias e obras (quando aplicável) em repositórios de direitos autorais ou bases que facilitem a prova de prioridade;

3. Manter arquivos com metadados originais e versões originais das produções para subsidiar perícias;

4. Avaliar estratégias de monitoramento de marca e imagem para identificar usos não autorizados de forma ágil.

A resposta pública de criadores, como a mencionada na reportagem — “Sue the living daylights out of them and hopefully get PAID.” — simboliza a combinação de indignação e a intenção de buscar reparação econômica diante de potencial apropriação indevida (LEI RV, 2026).

Como as marcas devem proceder para mitigar riscos jurídicos e éticos

Para empresas que utilizam ferramentas de inteligência artificial para produção de conteúdo visual, a adoção de políticas e processos de conformidade é imperativa. Recomendações práticas:

1. Due diligence sobre fontes de dados: verificar licenças e autorizações das imagens que compõem conjuntos de treinamento;

2. Implementar cláusulas contratuais com fornecedores de tecnologia que definam responsabilidades em caso de infração de direitos de terceiros;

3. Treinamento de equipes de marketing e agências parceiras para compreender limites legais e éticos no uso de IA;

4. Adoção de mecanismos de verificação e detecção de semelhança com pessoas reais antes da publicação de anúncios;

5. Comunicação clara ao público quando for utilizado conteúdo gerado por IA, evitando simular a presença de pessoas reais sem consentimento.

Essas medidas reduzem não apenas o risco de litígios, mas também potenciais danos reputacionais, ajudando a preservar confiança do consumidor.

Provas e estratégias jurídicas em casos de imagem gerada por IA

Em ações judiciais que envolvem suposto plágio de imagem por meio de IA, as partes e seus advogados devem focar em provas técnicas e documentais. Aspectos centrais de uma demanda incluem:

1. Perícia técnica em imagens: especialistas em processamento de imagens e IA podem analisar metadados, padrões de treinamento, e técnicas utilizadas para aferir a probabilidade de que uma imagem sintética tenha sido gerada com base em fotografias específicas;

2. Documentação de uso não autorizado: cópias de anúncios, datas de veiculação, materiais promocionais e capturas de tela;

3. Provas de autoria e precedência: arquivos originais, datas de postagem, contratos e registros que demonstrem a titularidade da imagem ou estilo;

4. Medidas cautelares: pedidos de remoção do conteúdo, bloqueio de veiculação e tutela provisória para resguardar direitos enquanto a ação principal é analisada.

A quantificação de danos pode incluir reparação por dano moral (pela violação da intimidade ou da imagem) e danos materiais (lucros cessantes ou prejuízos à remuneração futura), dependendo das circunstâncias.

Panorama internacional e tendências regulatórias

Diversas jurisdições vêm discutindo normas específicas para lidar com desafios introduzidos por inteligências artificiais, incluindo requisitos de transparência, rotulagem de conteúdo sintético e responsabilização de plataformas. Na União Europeia, por exemplo, a proposta de Regulamento de Inteligência Artificial estabelece obrigações em relação a sistemas de alto risco e à transparência do uso de conteúdos gerados por IA.

No Brasil, embora exista legislação relevante (Código Civil e LGPD), o debate sobre regulamentação específica para IA está em curso e inclui propostas de diretrizes para uso responsável. Espera-se que, ao longo dos próximos anos, avanços regulatórios tragam maior clareza sobre responsabilidade por conteúdos gerados por IA e proteções para titulares de direitos de personalidade.

Boas práticas de compliance e governança para setores criativos

Organizações que dependem fortemente de conteúdo visual devem construir um programa de governança de IA que inclua:

1. Políticas internas documentadas sobre uso de modelos geradores de imagem;

2. Auditorias periódicas dos dados de treinamento e dos fornecedores;

3. Procedimentos de aprovação de campanhas que verifiquem riscos de identificação de pessoas reais;

4. Mecanismos de resposta rápida a denúncias de uso indevido de imagem, incluindo canais de comunicação e equipes multidisciplinares (jurídico, comunicação e compliance).

Essas práticas contribuem para reduzir exposição legal e demonstram responsabilidade corporativa perante consumidores e stakeholders.

Conclusão

O episódio relatado — no qual a influenciadora Melanie Kieback alega que uma marca de moda utilizou imagens geradas por IA que reproduziam sua aparência sem autorização — ilustra um problema crescente: a interseção entre inovação tecnológica e proteção de direitos individuais (LEI RV, 2026). A resolução desse tipo de conflito exige uma combinação de estratégias: aperfeiçoamento regulatório, diligência empresarial, preparo jurídico e sensibilização ética no uso de tecnologias de criação de imagem.

Para profissionais da área, a lição é clara: proteção contratual, monitoramento ativo da imagem pessoal e preparo probatório são fundamentais. Para marcas, a recomendação é investir em compliance e transparência antes de adotar soluções de IA na produção publicitária. A prevenção, neste contexto, é tão importante quanto a capacidade de responder juridicamente a eventuais violações.

Referências e citações

No corpo do texto as informações provenientes da reportagem foram citadas conforme normas de citação: (LEI RV, 2026).

Referências em conformidade com normas ABNT:

Boredpanda.com. Reportagem de Lei RV. Model Calls Out Fashion Brand For Plagiarizing Her Likeness With AI Photos In Controversial Ad. 2026-03-02T22:22:57Z. Disponível em: https://www.boredpanda.com/model-accuses-fashion-brand-recreating-her-photos-controversial-ai-ad/. Acesso em: 2026-03-02T22:22:57Z.

Legislação citada:

BRASIL. Lei nº 10.406, de 10 de janeiro de 2002. Código Civil. Disponível em: https://www.planalto.gov.br. Acesso em: 2026-03-02.

BRASIL. Lei nº 13.709, de 14 de agosto de 2018. Lei Geral de Proteção de Dados Pessoais (LGPD). Disponível em: https://www.planalto.gov.br. Acesso em: 2026-03-02.

Fonte: Boredpanda.com. Reportagem de Lei RV. Model Calls Out Fashion Brand For Plagiarizing Her Likeness With AI Photos In Controversial Ad. 2026-03-02T22:22:57Z. Disponível em: https://www.boredpanda.com/model-accuses-fashion-brand-recreating-her-photos-controversial-ai-ad/. Acesso em: 2026-03-02T22:22:57Z.